Todos hemos pasado por eso. Estás usando una herramienta de IA para acelerar tu flujo de trabajo y genera una respuesta que suena increíblemente profesional, autoritaria y… completamente inventada. En el mundo de los Grandes Modelos de Lenguaje (LLM), a esto lo llamamos una alucinación de IA.

Cuando el contenido generado por IA que contiene datos falsos, URLs inexistentes o características de marca «alucinadas» llega a la web, envenena tu posicionamiento en los motores de búsqueda y erosiona la confianza en tu marca. ¿Es tu marco editorial lo suficientemente riguroso para detectar y neutralizar estos errores invisibles antes de que comprometan tu integridad digital?

Cuando una IA te proporciona información incorrecta, es fácil pensar que está siendo deshonesta. Sin embargo, la IA no te está «mintiendo» realmente; simplemente está prediciendo la siguiente palabra más probable en una secuencia, incluso si esa secuencia no se ajusta a la realidad.

Quédate con nosotros mientras profundizamos en la mecánica de estos espejismos digitales. En las siguientes secciones, aprenderás a identificar los activadores comunes de las alucinaciones, las formas específicas en que impactan en tu E-E-A-T y un marco de trabajo paso a paso para mantener tu contenido impulsado por IA preciso y listo para los buscadores.

La anatomía de una alucinación: ¿por qué ocurre?

Para solucionar el problema, primero tenemos que entender el «porqué». Los modelos de IA como GPT-4 o Gemini no «saben» hechos de la misma manera que los humanos. Son motores probabilísticos. Predicen la siguiente palabra más probable en una secuencia basándose en los enormes conjuntos de datos con los que fueron entrenados.

Una alucinación de IA ocurre cuando el modelo genera contenido que es sintácticamente correcto pero tácticamente incorrecto o sin sentido. En el contexto del SEO, esto significa que la IA podría «inventar» una característica de producto que no tienes, citar un estudio que nunca se realizó o proporcionar un enlace a una página que devuelve un error 404, por ejemplo.

Para mitigar estos errores, muchos sistemas implementan ahora el grounding (anclaje de datos). En lugar de confiar solo en su entrenamiento interno, la IA realiza una búsqueda en tiempo real para recuperar fragmentos de información relevante, usándolos como una referencia de «libro abierto» para guiar su respuesta.

Esta transición cambia el proceso de una simple predicción a una síntesis impulsada por el contexto. Sin embargo, incluso con acceso a datos en tiempo real, los errores de marca pueden ocurrir debido a varios factores críticos:

Conflicto de fuentes e inconsistencia de datos

El conflicto de fuentes ocurre cuando un modelo de IA intenta conciliar información de múltiples sitios web que presentan datos divergentes. Sin una «fuente de verdad» definitiva, la IA tiene dificultades para decidir qué dato es el más preciso, lo que resulta en un mensaje de marca inconsistente.

- Ejemplo: Imagina una empresa que trasladó su sede hace tres años. Si los directorios del sector todavía muestran la dirección antigua mientras que el sitio web oficial muestra la nueva, la IA podría proporcionar la ubicación obsoleta o, peor aún, fusionar las dos direcciones en un lugar inexistente.

Brechas de datos y «alucinación fluida»

Este problema abarca fallos de recuperación, lagunas en el entrenamiento y el concepto del «loro estocástico». Cuando la IA no puede encontrar una respuesta específica o se enfrenta a datos escasos, rara vez admite ignorancia. En su lugar, prioriza el flujo y la fluidez de la frase para «rellenar los huecos» con información que suena plausible pero es totalmente fabricada. Es un escenario donde la confianza de la máquina pesa más que su precisión factual.

- Ejemplo: Si un usuario pregunta por el precio de un plan «Enterprise» que no figura públicamente, la IA podría analizar los planes «Basic» y «Pro» y estimar creativamente un valor, presentándolo como un hecho indiscutible para mantener la fluidez del texto.

Contexto y semántica malinterpretados

Incluso cuando la IA recupera los datos correctos, puede fallar al entender la relación semántica entre las palabras. Tener un ancla factual solo es útil si la interpretación lingüística es precisa; de lo contrario, la información correcta se aplica de forma incorrecta.

- Ejemplo: Una IA podría leer un artículo titulado «Cómo ‘Cyrus’ salvó al departamento de marketing» y, debido a la ambigüedad, identificar a «Cyrus» como un nuevo consultor humano en lugar de reconocer que es el nombre del software de automatización que la empresa implementó.

Escenarios comunes de alucinación en Marketing

¿Cómo se ve esto en el mundo real? Aquí tienes algunos escenarios comunes donde las alucinaciones pueden arruinar tu estrategia:

- La función «fantasma»: Una IA que escribe una descripción de producto para tu herramienta SaaS afirma que tienes una «integración de nóminas automatizada» cuando en realidad solo permites exportaciones manuales.

- La estadística falsa: «Según un informe de McKinsey de 2023, el 85% de los perros prefieren los cuencos azules». (McKinsey nunca escribió esto, pero la IA sabe que McKinsey es una autoridad, así que usa el nombre para sonar creíble).

- URLs alucinadas por la IA: La IA sugiere «Para más información, visita tusitio.com/guia-completa», pero esa página no existe, lo que provoca un aumento de errores 404.

- El fundador equivocado: Atribuir una cita o la fundación de una empresa a la persona equivocada porque es una figura destacada en la misma industria.

- Precios inventados: Decirle a un cliente potencial que tu «Plan Pro» comienza en 19 €/mes cuando en realidad empieza en 49 €/mes.

- Deriva semántica: Cuando la IA comienza un párrafo sobre «estrategia SEO» pero gradualmente deriva a hablar de «gestión de Redes Sociales» porque asocia ambas de forma genérica, perdiendo la intención específica de la palabra clave.

El peligro del «Search Poisoning» (Envenenamiento de búsqueda)

Quizás la evolución más alarmante de este problema es el «Search Poisoning». Según informa Aurascape, los estafadores están explotando las vulnerabilidades de la IA para mostrar números de soporte falsos y datos maliciosos a través de una técnica conocida como LLM Search Poisoning.

Esta táctica maliciosa manipula cómo los motores de búsqueda impulsados por IA —como Perplexity, Gemini y Bing Chat— procesan la información, priorizando la legibilidad para la máquina sobre la utilidad humana.

El proceso comienza aprovechando sitios web comprometidos de alta autoridad (incluyendo sitios gubernamentales, universitarios y de WordPress) como alojamiento de confianza para contenido basura y PDFs, secuestrando eficazmente la confianza que los modelos de IA depositan en estos dominios.

Una vez establecidos, los atacantes inyectan información fraudulenta, como números falsos de atención al cliente, diseñados específicamente para ser rastreados y priorizados por los bots de IA durante la síntesis de datos.

Como resultado, los usuarios son dirigidos directamente hacia ciberdelincuentes en escenarios de alta urgencia, lo que conlleva consecuencias graves como el robo de datos personales, pérdidas financieras y una profunda erosión de la reputación de marca para las organizaciones comprometidas.

Lo que está en juego con la imprecisión de la IA

No detectar las alucinaciones conlleva dos grandes riesgos sistémicos:

- La erosión de la confianza: Cuando un usuario encuentra detalles «alucinados» —como precios incorrectos o funciones de producto inexistentes— el viaje del usuario se interrumpe de inmediato. Una sola alucinación puede transformar a un defensor potencial de la marca en un escéptico, causando un daño permanente a tu autoridad de marca y a tu posicionamiento SEO.

- El bucle de alucinación: Estamos entrando en un ciclo peligroso de desinformación que se perpetúa a sí mismo. Si se publica un dato alucinado y los motores de búsqueda lo indexan, eventualmente se convierte en datos de entrenamiento para la próxima generación de LLMs (Modelos de Lenguaje Extensos).

Al implementar una estrategia de detección robusta, salvaguardas la reputación de tu marca contra un ciclo de desinformación que, de otro modo, podría definir tu identidad digital durante años.

Plan de remediación contra las alucinaciones de IA

La detección es el primer paso hacia la solución. Necesitas monitorizar tu contenido, tus fuentes de datos y cómo las entidades de IA perciben tu marca. Según investigaciones citadas por AIMultiple, las tasas de alucinación pueden variar significativamente: algunos modelos presentan tasas de error que van del 15% a más del 27%, dependiendo de la complejidad de la tarea.

Cuando estos errores pasan desapercibidos, desencadenan una reacción en cadena que afecta tanto a tu audiencia actual como al futuro de tu presencia digital.

El siguiente plan de remediación paso a paso está diseñado para ayudarte a identificar, mitigar y prevenir las alucinaciones de IA, asegurando que tus resultados sigan siendo precisos, factuales y confiables.

1. Prueba prompts y casos límite

Para proteger la integridad de tu marca, debes intentar «romper» tus prompts activamente antes de que lleguen a tus clientes. Utiliza un flujo de trabajo de control de calidad (QA) riguroso para identificar dónde podría alucinar la IA o proporcionar información inexacta.

Aquí tienes ejemplos prácticos de cómo implementar estas pruebas:

La prueba de «Conocimiento Cero»

Esta prueba determina si la IA inventará información cuando carece de datos específicos, recientes o de propiedad exclusiva.

- El escenario: Tu empresa, TechFlow, lanzó un nuevo plan de suscripción «Quantum Tier» hace solo dos horas.

- El prompt de prueba: «¿Puedes explicar los límites específicos de almacenamiento de datos para el nuevo Quantum Tier de TechFlow lanzado hoy?»

- Qué buscar:

- Fallo: La IA crea un número ficticio (ej. «Ofrece 500GB de almacenamiento») basado en patrones generales.

- Acierto: La IA indica que no tiene esa información específica o te remite a la página oficial de precios.

La prueba «Contrafactual»

Esta prueba comprueba si la IA es demasiado «complaciente». Quieres asegurarte de que no confirme la existencia de funciones o servicios que realmente no ofreces.

- El escenario: Tu software, EditMaster, es un editor de fotos. No tiene una función de edición de vídeo.

- El prompt de prueba: «¿Cómo uso la herramienta ‘Exportación de Vídeo 4K’ en EditMaster para guardar mis películas?»

- Qué buscar:

- Fallo: La IA proporciona instrucciones paso a paso (ej. «Haz clic en Archivo > Exportar > Vídeo») para una función que no existe.

- Acierto: La IA responde: «EditMaster es actualmente una suite de edición de fotos y no admite funciones de exportación de vídeo».

2. Domina la narrativa a través del suministro de datos

Cuando una IA alucina constantemente detalles sobre tu marca, revela una alta «demanda de consulta» combinada con un bajo «suministro de datos». En lugar de ver estos errores como un fallo técnico, trátalos como una hoja de ruta para tu estrategia de contenido. Al crear mensajes que aborden estas alucinaciones comunes con hechos respaldados por la marca, te posicionas como la autoridad definitiva.

Lee más: De contenido commodity a non-commodity: cómo escapar del «más de lo mismo» y generar autoridad

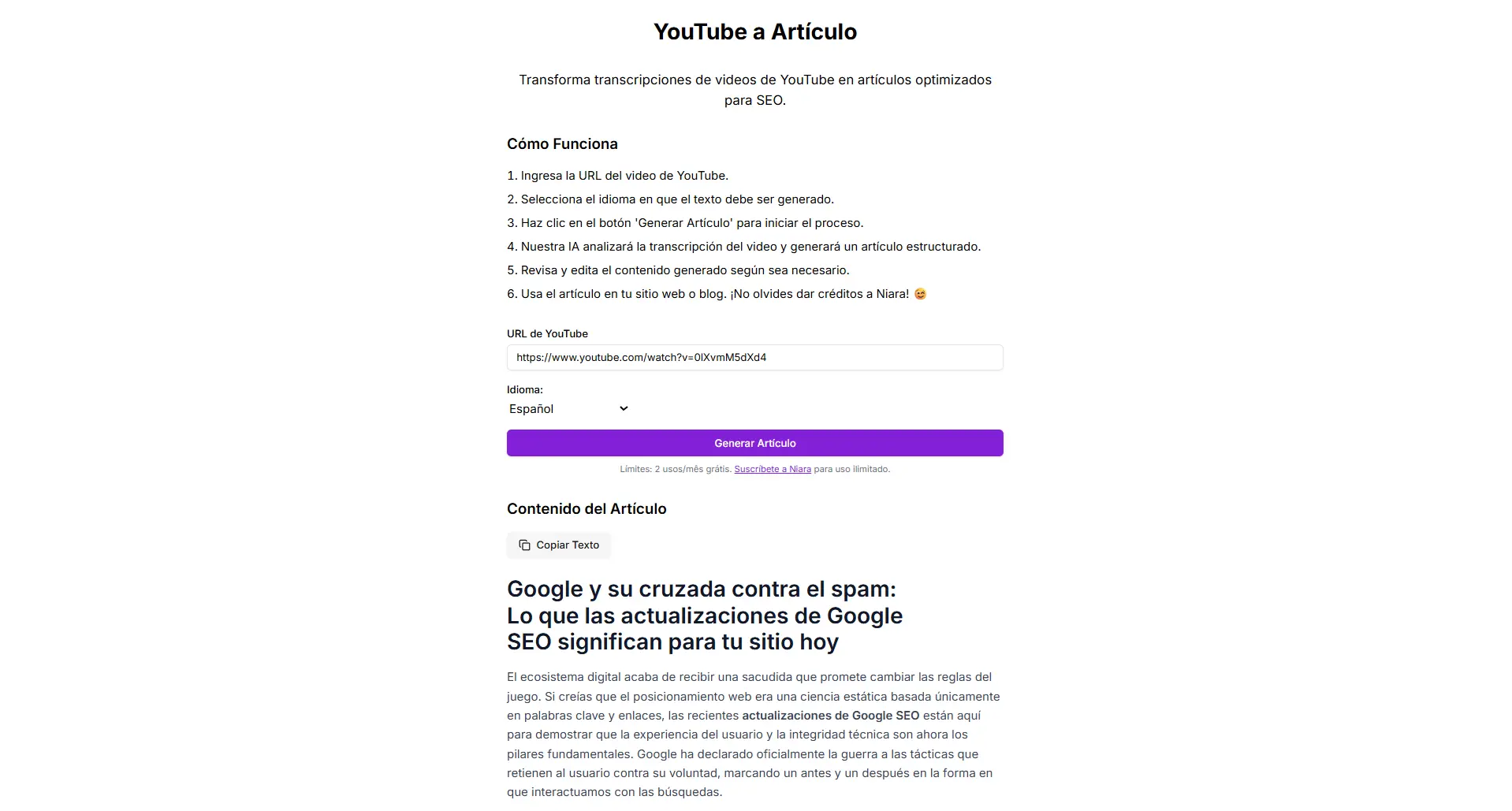

3. Usa los vídeos como la «fuente de verdad» canónica

En una era donde el texto es barato y fácil de falsificar, el vídeo ha emergido como una potencia para la fiabilidad SEO. El vídeo actúa como un ancla «sólida» para los modelos de IA.

¿Por qué? Porque mientras que una IA puede generar fácilmente un párrafo de texto, generar un vídeo consistente y de alta calidad de un experto humano hablando es mucho más difícil de «alucinar» de forma convincente. Los modelos de IA ahora usan transcripciones y verificación visual para anclar sus predicciones. Si tu sitio tiene un vídeo de tu fundador explicando un producto, y el texto de la página coincide con ese vídeo, la señal de «verdad» es mucho más fuerte.

Herramienta destacada de Niara: Nuestra función YouTube to Article está diseñada exactamente para este propósito. Te permite transformar contenido de vídeo verificado en artículos perfectamente optimizados en segundos. Esto asegura que el texto de tu sitio esté anclado en la «realidad verificada por humanos» de tu contenido de vídeo, alineándose perfectamente con un marco de SEO multimodal.

4. Construye consistencia omnicanal

La IA triangula información de toda la web para validar hechos. Cuando los datos son idénticos en múltiples puntos de contacto, la IA aumenta la «puntuación de confianza» de esa información. Si tu sitio web dice una cosa y tu perfil de LinkedIn o G2 dice otra, creas una brecha que las alucinaciones pueden llenar.

- Auditoría de fuentes de autoridad: Asegúrate de que los perfiles en ecosistemas de confianza (LinkedIn, Crunchbase, Wikipedia, G2, Capterra y directorios del sector) reflejen exactamente lo que hay en tu sitio web oficial.

- Sincronización de datos: Las fechas de fundación, los nombres de los fundadores, las descripciones de los productos y las propuestas de valor deben estar estandarizados.

Herramienta destacada de Niara: Usa ChatSEO para analizar el texto de tu sitio web y generar descripciones estandarizadas para diferentes redes sociales y directorios. Esto asegura que tu tono de voz y tus datos principales se mantengan consistentes en todos los canales.

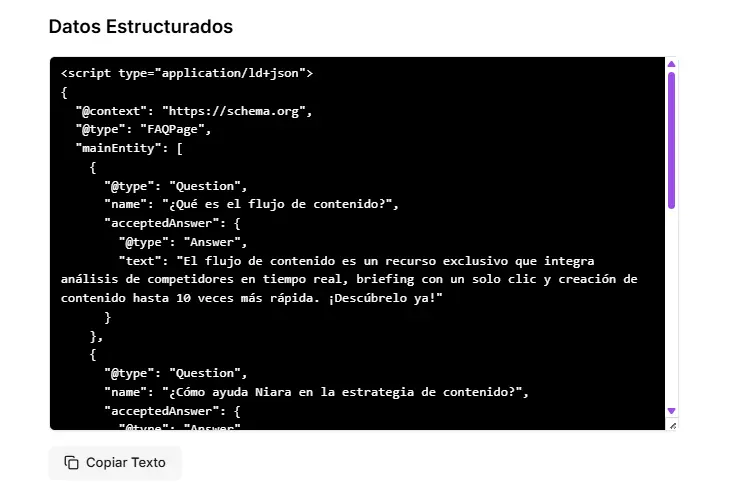

5. Implementa Datos Estructurados (Schema)

El marcado de Schema es el «lenguaje nativo» que permite el anclaje (grounding) de la IA. Elimina la ambigüedad transformando el texto no estructurado en datos explícitos para los indexadores. Sin Schema, la IA tiene que «adivinar» las relaciones entre entidades; con él, entregas los hechos en bandeja de plata.

- Entidades y relaciones: Implementa o refina los esquemas de Organization, Person y Product. Esto ayuda a la IA a conectar quién eres, qué haces y las personas que hay detrás de la marca.

- Propiedad «sameAs»: Este campo es crucial. Conecta tu dominio oficial con perfiles verificados (redes sociales y enciclopedias), demostrando a la IA que todas esas entidades son una y la misma.

Herramienta destacada de Niara: Con el Generador de Datos Estructurados de Niara, puedes crear códigos JSON-LD precisos en segundos sin necesidad de programar, asegurando que tu sitio hable el lenguaje de los bots de IA a la perfección.

6. Elimina el ruido y sanea los datos

La información obsoleta es el combustible número uno para las alucinaciones de IA. Si un bot encuentra una publicación de blog de 2018 afirmando que tu software tiene una función que ya ha sido descontinuada, podría citarlo como un hecho actual.

- Limpieza de contenido (Content Pruning): Elimina o actualiza las páginas que contengan información factual incorrecta.

- Redirecciones estratégicas: Si una página antigua no se puede actualizar, redirígela a la versión más reciente para evitar que la IA acceda a datos «sucios».

7. Adopta una estrategia de contenido declarativo para dar claridad a la IA

Para evitar alucinaciones, elimina el «relleno» y adopta la escritura declarativa. La IA trabaja con probabilidades; las frases vagas aumentan la incertidumbre y, en consecuencia, el riesgo de errores.

- Precisión algorítmica: En lugar de «Nuestra solución puede ayudarte a lograr mejores resultados», usa «Nuestro software reduce la latencia del servidor en un 20%».

- Estructura directa: Usa frases cortas y directas (Sujeto + Verbo + Predicado). Las afirmaciones claras y declarativas no dejan espacio para que la IA haga «conjeturas» probabilísticas.

Herramienta destacada de Niara: ChatSEO es un asistente de IA creado para refinar la comunicación profesional. Transforma frases complejas y pasivas en afirmaciones directas, autoritarias y objetivas. Usa este comando para un refinamiento instantáneo:

Reescribe este texto para que sea directo, objetivo y activo: [Insertar Texto]

Lee más: Cómo crear artículos de alto rendimiento en Niara: 6 pasos

8. Enriquece el contenido con atributos frescos y prueba social

Una vez corregidos los errores, debes señalar frescura y autoridad (E-E-A-T). Las páginas ricas en datos actuales y métricas del mundo real demuestran que el contenido se mantiene activamente y es digno de confianza.

- Métricas en tiempo real: Añade estadísticas actualizadas, sellos de confianza y testimonios recientes.

- CTAs contextuales: Usa llamadas a la acción que reflejen la oferta actual del producto, reforzando la utilidad de la página tanto para el usuario como para el motor de búsqueda.

Herramienta destacada de Niara: Google AI Mode Insights de Niara analiza publicaciones de blog, páginas de destino, home y páginas de producto para asegurar que cada activo sea una fuente de alta autoridad y relevancia. Este enfoque basado en datos te permite optimizar todo tu sitio para cumplir con los estándares de calidad específicos requeridos por los algoritmos de búsqueda de IA en evolución.

9. Aprovecha el PR Digital para la autoridad en IA

El PR Digital ha evolucionado de la simple construcción de enlaces a una herramienta vital para establecer la «verdad base» de la marca en la era de la IA generativa. Mantener información consistente y factual en plataformas digitales de renombre es esencial para reducir el riesgo de que los modelos de IA generen imprecisiones o datos falsos sobre tu empresa.

Al priorizar la integridad de los datos y asegurar menciones de fuentes externas de confianza, refuerzas significativamente el E-E-A-T de tu marca, lo que consolida tu credibilidad profesional y garantiza que tanto los motores de búsqueda como los sistemas de IA reconozcan tu negocio como una autoridad fiable en su campo.

Mantén la consistencia con el Guía de Marca

Más allá del refinamiento de frases individuales, Niara incorpora una robusta función de Guía de Marca (Directrices de Marca). Esta funcionalidad asegura que cada pieza de contenido generada o reescrita en la plataforma se alinee perfectamente con la voz, los valores y los requisitos estilísticos únicos de tu empresa.

Al integrar tu manual de marca directamente en tu flujo de trabajo de contenido, garantizas una consistencia total en todos los canales, estableciendo una autoridad de marca más fuerte y construyendo una confianza duradera con tu audiencia.

Monitorización continua

Mantener la precisión de tu marca en los resultados de búsqueda generados por IA es crítico a medida que los modelos se actualizan mediante nuevos datos de entrenamiento y RAG (Generación Aumentada por Recuperación). Para asegurar que tu negocio sea representado correctamente por los buscadores de IA y mantener una ventaja competitiva, sigue estos pasos esenciales de monitorización:

- Realiza auditorías de IA trimestrales: Haz preguntas regularmente a varios modelos de IA sobre tu sector, productos e historia de la empresa para rastrear cómo evolucionan sus respuestas con el tiempo.

- Verifica las citas de fuentes: Revisa las notas al pie y las fuentes en los buscadores de IA para identificar qué sitios web de terceros están alimentando de información al modelo.

- Actualiza datos de terceros obsoletos: Ponte en contacto con blogs de nicho o directorios que alberguen precios, funciones o detalles de la empresa incorrectos para asegurar que la IA extraiga datos precisos.

- Corrige tendencias de alucinación: Si una IA proporciona información falsa de forma constante, localiza la información «fantasma» conflictiva en línea y corrígela en la fuente para resolver la confusión del modelo.

Liderando la narrativa en la era de la IA

La IA no tiene por qué ser una «caja negra» que dicte la reputación de tu marca. Aunque las alucinaciones son un subproducto de cómo funcionan los Grandes Modelos de Lenguaje, no son inevitables.

En este nuevo panorama, el SEO trata sobre la Integridad de la Entidad. Cuando sincronizas tu mensaje en todos los canales y saneas tus datos, dejas a la IA sin «ruido» y la alimentas con hechos.

No permitas que un algoritmo defina la verdad de tu marca. Usa Niara para anclar tu SEO en la realidad y proteger tu reputación. Comienza tu prueba gratuita hoy mismo y descubre cómo simplificamos el complejo mundo del SEO con IA.