Todos nós já passamos por isso. Você está usando uma ferramenta de IA para acelerar seu fluxo de trabalho e ela gera uma resposta que parece incrivelmente profissional, autoritária e… completamente inventada. No mundo dos Grandes Modelos de Linguagem (LLMs), chamamos isso de alucinação de IA.

Quando um conteúdo gerado por IA contendo fatos falsos, URLs inexistentes ou recursos de marca “alucinados” chega à web, ele envenena seu ranking nos mecanismos de busca e destrói a confiança na marca. Seu processo editorial é rigoroso o suficiente para detectar e neutralizar esses erros invisíveis antes que eles comprometam sua integridade digital?

Quando uma IA fornece informações incorretas, é fácil pensar que ela está sendo desonesta. No entanto, a IA não está exatamente “mentindo” para você; ela está apenas prevendo a próxima palavra mais provável em uma sequência, mesmo que essa sequência não esteja alinhada com a realidade.

Continue com a gente para entender melhor como funcionam essas “miragens digitais”. A seguir, você aprenderá a identificar os gatilhos comuns de alucinação, as formas específicas como elas impactam seu E-E-A-T e um passo a passo para manter seu conteúdo gerado por IA preciso e pronto para o Google.

A anatomia da alucinação de IA: por que ela acontece?

Para corrigir o problema, primeiro precisamos entender o “porquê”. Modelos de IA como o GPT-4 ou o Gemini não “sabem” fatos da mesma forma que os humanos. Eles são mecanismos probabilísticos. Eles preveem a próxima palavra com base nos enormes conjuntos de dados com os quais foram treinados.

Uma alucinação de IA ocorre quando o modelo gera um conteúdo que é gramaticalmente correto, mas factualmente errado ou sem sentido. No contexto do SEO, isso significa que a IA pode “inventar” uma funcionalidade de produto que você não tem, citar um estudo que nunca existiu ou fornecer um link para uma página que retorna erro 404, por exemplo.

Para mitigar esses erros, muitos sistemas agora implementam o grounding (ancoragem). Em vez de confiar apenas no seu treinamento interno, a IA realiza uma busca em tempo real para recuperar trechos de informações relevantes, usando-os como uma referência de “livro aberto” para guiar sua resposta.

Essa transição muda o processo de uma simples previsão para uma síntese baseada em contexto. No entanto, mesmo com acesso a dados em tempo real, erros de marca ainda podem ocorrer devido a alguns fatores críticos:

Conflito de fontes e inconsistência de dados

O conflito de fontes ocorre quando um modelo de IA tenta conciliar informações de vários sites que apresentam fatos divergentes. Sem uma “fonte única da verdade”, a IA tem dificuldade em decidir qual dado é o mais preciso, resultando em mensagens de marca inconsistentes.

- Exemplo: imagine uma empresa que mudou de sede há três anos. Se diretórios antigos ainda listam o endereço antigo enquanto o site oficial mostra o novo, a IA pode fornecer a localização desatualizada ou, pior, fundir os dois endereços em um lugar que não existe.

Lacunas de dados e “alucinação fluente”

Quando a IA não encontra uma resposta específica, ela raramente admite ignorância. Em vez disso, prioriza a fluidez da frase para “preencher as lacunas” com informações que parecem plausíveis, mas são fabricadas. É um cenário onde a confiança da máquina supera sua precisão factual.

- Exemplo: se um usuário pergunta o preço de um plano “Enterprise” que não está listado publicamente, a IA pode analisar os planos “Básico” e “Pro” e estimar um valor criativamente, apresentando-o como um fato indiscutível para manter o fluxo do texto.

Contexto e semântica mal interpretados

Mesmo quando a IA recupera os dados corretos, ela pode falhar ao entender a relação semântica entre as palavras. Ter uma âncora factual só é útil se a interpretação linguística for precisa; caso contrário, a informação correta é aplicada de forma errada.

- Exemplo: uma IA pode ler um artigo intitulado “Como o ‘Ciro’ salvou o departamento de marketing” e, por ambiguidade, identificar “Ciro” como um novo consultor humano, em vez de reconhecer que é o nome do software de automação que a empresa implementou.

Cenários comuns de alucinação no marketing

Como isso aparece na prática? Alguns cenários comuns onde as alucinações podem prejudicar sua estratégia incluem:

- A funcionalidade “fantasma”: uma IA escreve a descrição de um software e afirma que ele tem “integração automática com o WhatsApp”, quando na verdade você só suporta exportação manual.

- A estatística falsa: “De acordo com um relatório da McKinsey de 2023, 85% dos brasileiros preferem café sem açúcar.” (A McKinsey nunca escreveu isso, mas a IA sabe que a McKinsey é uma autoridade, então usa o nome para parecer confiável).

- URLs alucinadas: a IA sugere “Para saber mais, visite seunsite.com.br/guia-completo”, mas essa página não existe, gerando um pico de erros 404.

- O fundador errado: atribuir uma frase ou a fundação de uma empresa à pessoa errada porque ela é uma figura proeminente no mesmo setor.

- Preços inventados: dizer a um potencial cliente que seu plano custa R$ 19,00/mês quando, na verdade, começa em R$ 49,00/mês.

- Desvio semântico: quando a IA começa um parágrafo sobre “estratégia de SEO”, mas gradualmente passa a falar sobre “gestão de redes sociais” porque associa os dois termos de forma ampla, perdendo a intenção específica da palavra-chave.

O perigo do envenenamento de busca

Talvez a evolução mais alarmante deste problema seja o “envenenamento de busca”. Conforme relatado pela Aurascape, golpistas estão explorando vulnerabilidades de IA para exibir números de suporte falsos e dados maliciosos através de uma técnica conhecida como LLM Search Poisoning.

Essa tática manipula como os buscadores baseados em IA, como Perplexity, Gemini e Bing Chat, processam informações, priorizando a leitura da máquina em vez da utilidade humana.

O processo começa aproveitando sites de alta autoridade comprometidos (incluindo sites governamentais e universidades) como hospedagem confiável para conteúdo de spam e PDFs, sequestrando a confiança que os modelos de IA depositam nesses domínios.

Uma vez estabelecidos, os hackers injetam informações fraudulentas, como números falsos de atendimento ao cliente, projetados especificamente para serem capturados pelos robôs de IA durante a síntese de dados.

Como resultado, os usuários são direcionados para cibercriminosos em momentos de urgência, levando a consequências graves, como roubo de dados pessoais, perda financeira e uma profunda erosão da reputação da marca.

Os altos riscos da imprecisão da IA

Falhar em capturar alucinações leva a dois grandes riscos sistêmicos:

- A erosão da confiança: quando um usuário encontra detalhes “alucinados”, como preços errados ou recursos inexistentes, a jornada de compra é interrompida. Uma única alucinação pode transformar um potencial defensor da marca em um cético.

- O ciclo da alucinação: estamos entrando em um ciclo perigoso de desinformação autopertuante. Se um fato alucinado é publicado e indexado pelo Google, ele acaba se tornando dado de treinamento para a próxima geração de LLMs.

Ao implementar uma estratégia de detecção robusta, você protege a reputação da sua marca contra um ciclo de desinformação que poderia definir sua identidade digital por anos.

Plano de remediação contra alucinações de IA

A detecção é o primeiro passo para a correção. Você precisa monitorar seu conteúdo, seus feeds de dados e como as entidades de IA percebem sua marca. Pesquisas indicam que as taxas de alucinação podem variar significativamente. Alguns modelos exibem taxas de erro de 15% até mais de 27%, dependendo da complexidade da tarefa.

Quando esses erros passam despercebidos, eles disparam uma reação em cadeia que impacta seu público atual e o futuro da sua presença digital.

O plano de remediação a seguir foi desenhado para ajudar você a identificar, mitigar e prevenir alucinações de IA, garantindo que seus resultados permaneçam precisos e confiáveis.

1. Teste prompts e casos extremos

Para proteger a integridade da sua marca, você deve tentar “quebrar” seus prompts antes que eles cheguem aos seus clientes. Use um fluxo de revisão rigoroso para identificar onde a IA pode inventar dados.

O teste de “conhecimento zero”

Este teste determina se a IA inventará informações quando faltarem dados específicos ou recentes.

- O cenário: sua empresa, a TechFlow, lançou um novo plano “Quantum” há apenas duas horas.

- O prompt de teste: “Quais são os limites específicos de armazenamento do novo plano Quantum da TechFlow lançado hoje?”

- O que observar:

- Falha: a IA cria um número fictício (ex: “Oferece 500GB”) com base em padrões gerais.

- Sucesso: a IA afirma que não tem essa informação específica ou direciona você para a página oficial de preços.

O teste contrafactual

Este teste verifica se a IA é “concordante” demais. Você quer garantir que ela não confirme a existência de recursos que você não oferece.

- O cenário: seu software, o EditMaster, é um editor de fotos. Ele não tem recurso de edição de vídeo.

- O prompt de teste: “Como eu uso a ferramenta de ‘Exportação de Vídeo em 4K’ no EditMaster para salvar meus filmes?”

- O que observar:

- Falha: a IA fornece instruções passo a passo para um recurso que não existe.

- Sucesso: a IA responde que o EditMaster é focado em edição de fotos e não suporta exportação de vídeos.

2. Domine a narrativa através da oferta de dados

Quando uma IA alucina consistentemente sobre sua marca, isso revela uma alta “demanda de busca” combinada com uma baixa “oferta de dados”. Em vez de ver isso apenas como uma falha técnica, trate como um mapa para sua estratégia de conteúdo. Ao criar mensagens que abordam essas alucinações com fatos reais, você se posiciona como a autoridade definitiva.

Leia mais: Como criar conteúdo não-commodity e se destacar

3. Use vídeos como a “fonte da verdade”

Em uma era onde o texto é barato e fácil de falsificar, o vídeo surge como uma potência para a confiabilidade no SEO. O vídeo atua como uma âncora “rígida” para os modelos de IA.

Por quê? Porque embora uma IA possa gerar texto facilmente, gerar um vídeo consistente de um especialista humano falando é muito mais difícil de “alucinar” de forma convincente. Se o seu site tem um vídeo do fundador explicando um produto e o texto da página condiz com esse vídeo, o sinal de “verdade” é muito mais forte.

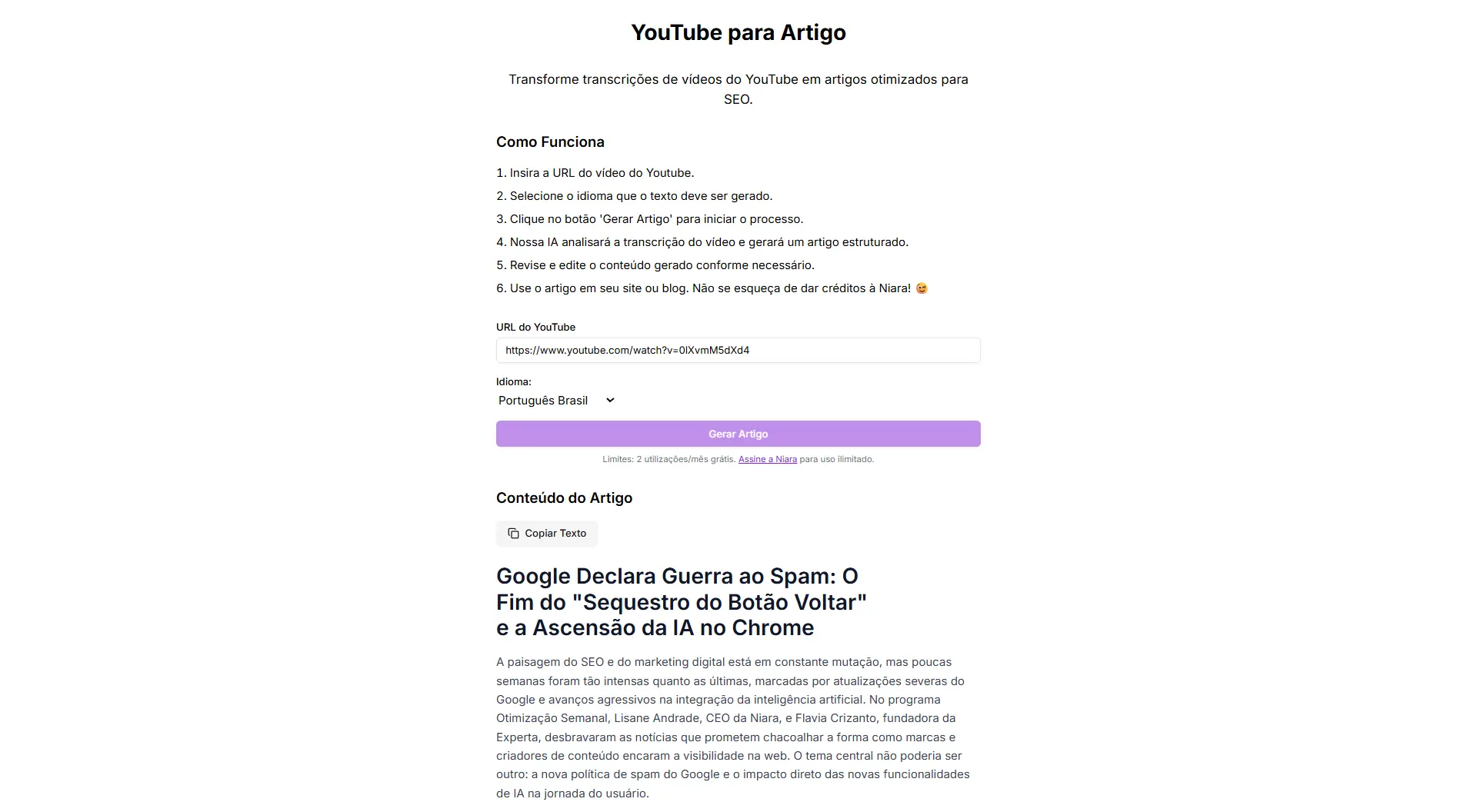

Destaque da Niara: nossa ferramenta de YouTube para Artigo foi feita para isso. Ela permite transformar vídeos verificados em artigos otimizados em segundos, garantindo que o texto do seu site esteja ancorado na realidade humana para construção de uma estratégia multimodal.

4. Construa consistência entre canais

A IA triangula informações de toda a web para validar fatos. Se o seu site diz uma coisa e seu perfil no LinkedIn ou G2 diz outra, você cria uma brecha para alucinações.

- Auditoria de fontes de autoridade: garanta que perfis em ecossistemas confiáveis (LinkedIn, Crunchbase, Wikipedia) reflitam exatamente o que está no seu site oficial.

- Padronização de dados: datas de fundação, nomes de sócios e descrições de produtos devem ser padronizados.

Destaque da Niara: use o ChatSEO para analisar o texto do seu site e gerar descrições padronizadas para diferentes redes sociais e diretórios.

5. Implemente dados estruturados (Schema)

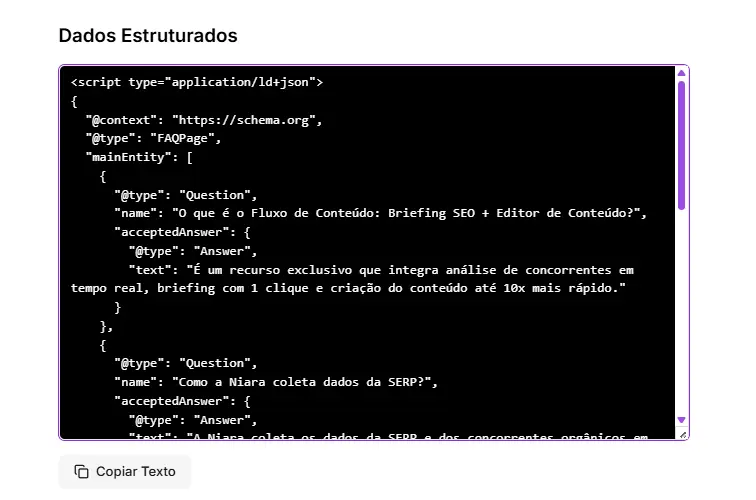

O Schema Markup é a “língua nativa” que permite a ancoragem da IA. Ele elimina a ambiguidade ao transformar texto não estruturado em dados explícitos para os indexadores.

- Entidades e relacionamentos: refine os Schemas de Organização, Pessoa e Produto. Isso ajuda a IA a conectar quem você é e o que você faz.

- Propriedade “sameAs”: este campo é crucial. Ele conecta seu domínio oficial aos seus perfis verificados, provando para a IA que todas essas entidades são a mesma.

Destaque da Niara: com o Gerador de Dados Estruturados da Niara, você cria códigos JSON-LD precisos em segundos, sem precisar programar.

6. Remova ruídos e sanitize seus dados

Informações obsoletas são o combustível número um para alucinações. Se um robô encontra um post de 2018 dizendo que seu software tem um recurso que já foi descontinuado, ele pode citar isso como um fato atual.

- Poda de conteúdo: remova ou atualize páginas com informações factuais incorretas.

- Redirecionamentos estratégicos: se uma página antiga não pode ser atualizada, redirecione-a para a versão mais recente.

7. Adote uma estratégia de conteúdo declarativa

Para evitar alucinações, corte o “enchimento” e adote a escrita declarativa. Frases vagas aumentam a incerteza e o risco de erros da IA.

- Precisão algorítmica: em vez de “Nossa solução pode ajudar você a ter melhores resultados”, use “Nosso software reduz a latência do servidor em 20%”.

- Estrutura direta: use frases curtas e diretas (sujeito + verbo + predicado).

Destaque da Niara: o ChatSEO ajuda a transformar frases passivas e complexas em afirmações diretas e autoritárias. Use este comando para um ajuste instantâneo:

Reescreva este texto para que seja direto, objetivo e com voz ativa: [Inserir texto]

Leia mais: Do zero ao artigo otimizado (SEO): 6 Passos com a Niara

8. Enriqueça o conteúdo com prova social e dados frescos

Páginas ricas em métricas do mundo real demonstram que o conteúdo é mantido ativamente e é confiável.

- Métricas em tempo real: adicione estatísticas atualizadas, selos de confiança e depoimentos recentes.

- CTAs contextuais: use chamadas para ação que reflitam a oferta atual do produto.

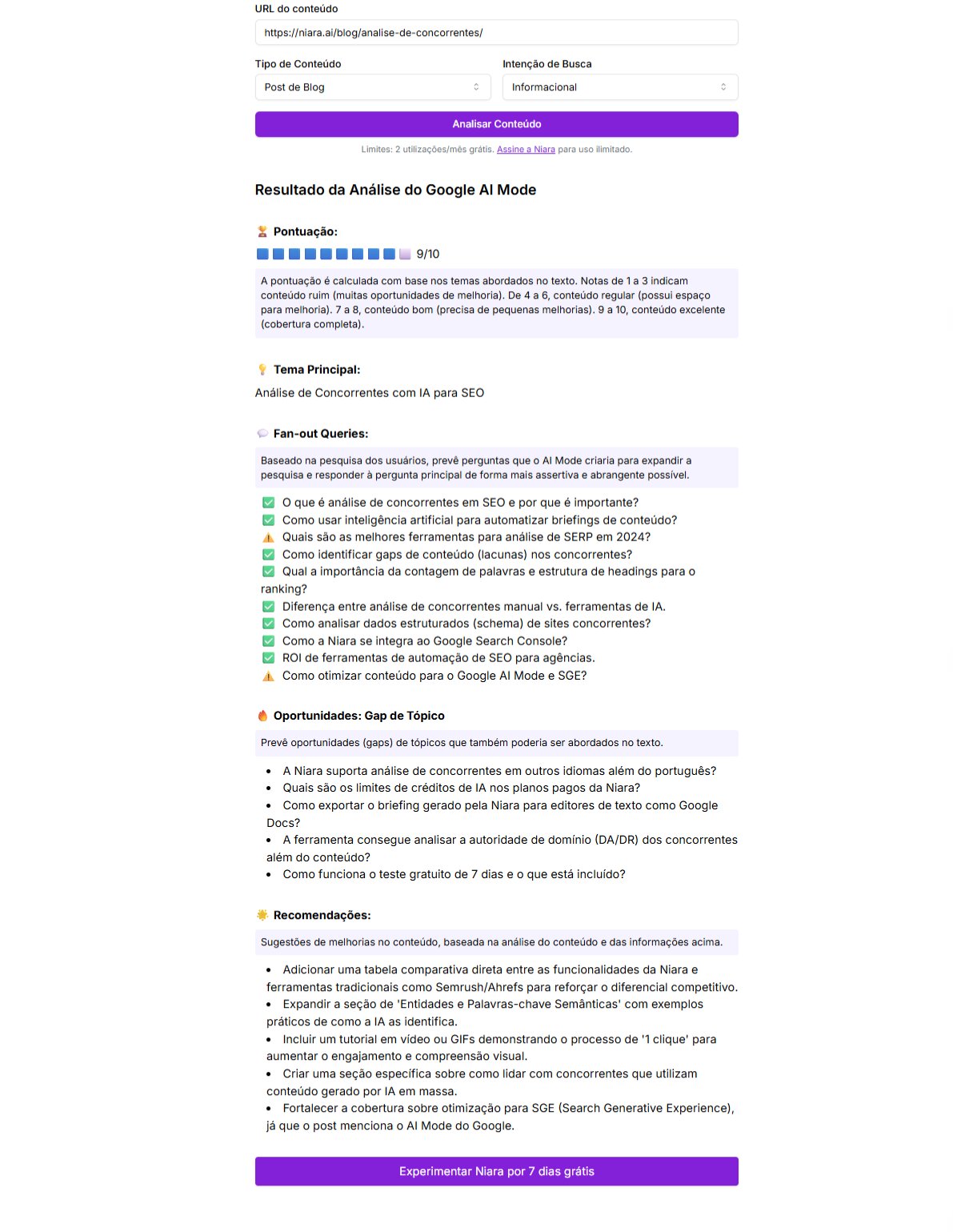

Destaque da Niara: o Google AI Mode Insights da Niara analisa suas páginas para garantir que cada ativo seja uma fonte de alta autoridade, otimizando seu site para os novos padrões de busca por IA.

9. Use o PR Digital para autoridade de IA

O PR Digital (Relações Públicas Digital) evoluiu de uma simples estratégia de link building para uma ferramenta vital na criação da “fonte da verdade” (ground truth) de uma marca na era da IA Generativa. Manter informações consistentes e factuais em plataformas digitais de renome é essencial para reduzir o risco de modelos de IA gerarem imprecisões ou informações falsas sobre sua empresa.

Ao priorizar a integridade dos dados e conquistar menções em fontes externas de confiança, você reforça significativamente o E-E-A-T da sua marca. Isso consolida sua credibilidade profissional e garante que tanto os motores de busca quanto os sistemas de IA reconheçam seu negócio como uma autoridade confiável em seu setor.

Leia mais: O papel do SEO na construção da reputação digital

Mantenha a consistência com as diretrizes da marca

Além do refinamento individual de frases, a Niara incorpora um recurso robusto de Brand Guidelines. Esta funcionalidade garante que cada conteúdo gerado ou reescrito na plataforma esteja perfeitamente alinhado à voz, aos valores e aos requisitos estilísticos exclusivos da sua empresa.

Ao integrar seu brand book diretamente ao seu fluxo de trabalho de conteúdo, você garante uma consistência impecável em todos os canais, estabelecendo uma autoridade de marca mais forte e construindo uma confiança duradoura com seu público.

Monitoramento contínuo

Manter a precisão da sua marca nos resultados de busca gerados por IA é um trabalho contínuo. Siga estes passos essenciais:

- Realize auditorias de IA trimestrais: faça perguntas a diferentes modelos de IA sobre sua indústria e empresa e monitore como as respostas evoluem.

- Verifique as citações de fontes: veja quais sites de terceiros estão alimentando a IA com informações sobre você.

- Atualize dados de terceiros desatualizados: entre em contato com blogs ou diretórios que exibem preços ou recursos errados para corrigir a informação na fonte.

- Corrija tendências de alucinação: se a IA insiste em um dado falso, localize a informação “fantasma” online e resolva a confusão do modelo.

Comandando a narrativa na era da IA

A IA não precisa ser uma “caixa preta” que dita a reputação da sua marca. Embora as alucinações sejam um subproduto de como os modelos funcionam, elas não são inevitáveis.

Neste novo cenário, o SEO é sobre Integridade da Entidade. Quando você sincroniza sua mensagem e limpa seus dados, você tira o “ruído” da IA e fornece os fatos.

Não deixe um algoritmo definir a verdade da sua marca. Use a Niara para ancorar seu SEO na realidade e proteger sua reputação. Comece seu teste gratuito hoje e veja como simplificamos o mundo do SEO com IA.