Otimização Semanal #24: Update no Google Discover e o Fim das Listas Auto-Promocionais

Olá, comunidade de SEO e Marketing, hoje completamos 6 meses de programa!

Já são 24 semanas seguidas, sem pausa. E mais de 1.000 minutos compartilhando o que realmente importa no mundo da busca.

E hoje, temos mais novidades fresquinhas. E o tema da vez é: Qualidade Técnica e Autoridade Real.

O Google decidiu “fechar o cerco” para conteúdos superficiais no Discover e para códigos pesados no rastreamento. Se você sentiu oscilações no tráfego ou está preocupado com o limite de 2MB do Googlebot, este resumo é para você.

Ative a notificação para não perder os próximos episódios. 💜

Vamos aos destaques de hoje?

Google Discover: O Fim do Clickbait e a Era da Expertise

No dia 5 de fevereiro de 2026, o Google lançou um Core Update específico para o Discover. Inicialmente focado em usuários de língua inglesa nos EUA, a atualização já sinaliza o que vem por aí para o resto do mundo: chega de conteúdo raso, sensacionalista.

O buscador refinou seus sistemas baseando-se em três pilares:

- Relevância Local: Sites que cobrem notícias da sua própria região ganham prioridade.

- Guerra ao Clickbait: Títulos exagerados que não entregam o que prometem serão penalizados. O foco é qualidade, não o clique sujo.

- Expertise Tópico por Tópico: O Google agora avalia a expertise de um site em clusters específicos, não apenas o site como um todo.

- Exemplo do Google: Um site de notícias locais que tem uma seção dedicada e recorrente sobre “Jardinagem” terá autoridade nesse tema. Um site de cinema que faz um post aleatório sobre jardinagem não aparecerá no Discover.

Não basta ter um único artigo viral. Você precisa preencher todos os gaps de conteúdo sobre um tema para ser considerado uma autoridade.

🔗 Fonte: Google Discover Core Update

Para ajudar nessa jornada de organização de conteúdo, ferramentas como o Mapa de Autoridade da Niara surgem para automatizar o diagnóstico de clusters e lacunas de conteúdo, facilitando a vida de quem precisa dominar um nicho. Lançamento em fevereiro de 2026.

Limite de Rastreamento do Googlebot: A Regra dos 2MB

Esta foi a notícia técnica da semana. No dia 06/02, o Google atualizou sua documentação declarando explicitamente que rastreia apenas os primeiros 2MB de arquivos HTML e outros formatos (exceto PDFs).

O robô baixa os primeiros 2MB. Se o arquivo for maior, ele corta o restante. O que ficou de fora, para o Google, não existe.

⚠️ O Detalhe Vital: Descompressão

O limite é aplicado aos dados não comprimidos (uncompressed). Seu arquivo pode ter 200KB transferidos via rede (Gzip/Brotli), mas se ao ser “descompactado” ele virar 3MB, o Google cortará nos 2MB.

Quem corre mais risco?

- Sites em CSR (Client-Side Rendering): Se o seu arquivo JS principal (bundle) for muito pesado, o Google pode não baixar a lógica necessária para renderizar o site.

- Imagens em Base64: Elas geram códigos imensos diretamente no HTML.

- Listagens Infinitas: E-commerces que carregam centenas de produtos no código fonte inicial sem paginação.

Dica da Niara: Eficiência de código também é SEO. Use o “Inspecionar” do Chrome para ver o peso do HTML ou a Ferramenta de Inspeção de URL do Search Console para verificar se o Google leu o código todo.

🔗 Fonte: Googlebot crawling limits e no blog da Niara saiba o que muda na indexação e como evitar o “corte” do seu conteúdo.

O fim das listas autopromocionais

Sabe aquela estratégia de criar um artigo “Os 10 Melhores Softwares de 2026” e colocar sua própria empresa em 1º lugar sem critério nenhum? O Google começou a punir isso severamente.

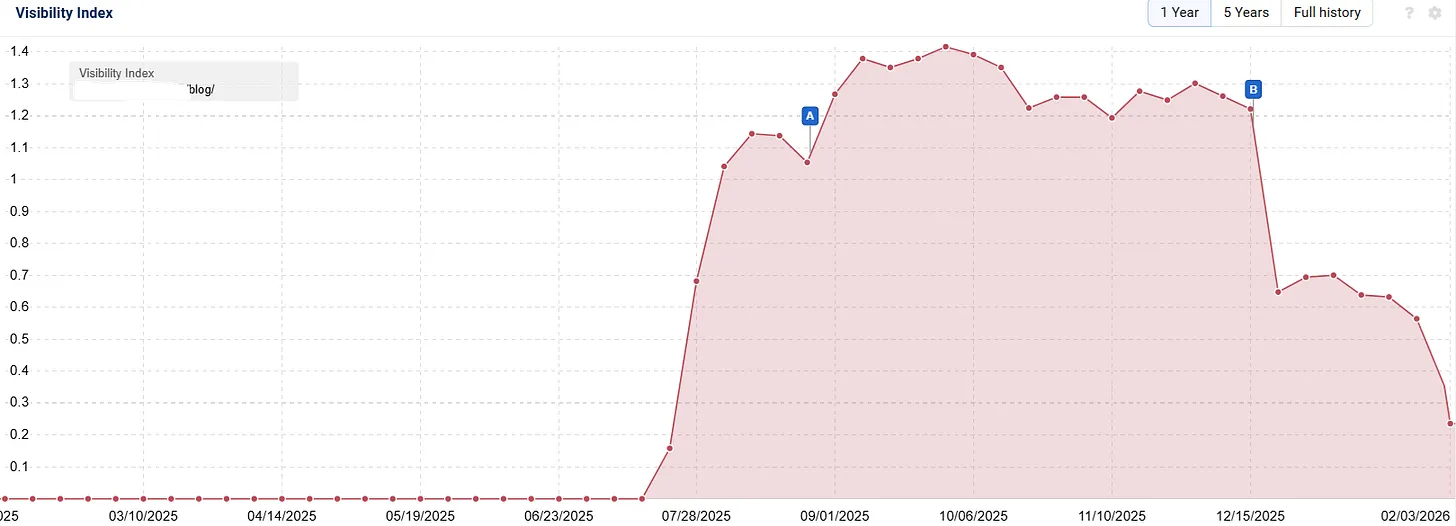

Um estudo recente da Lily Ray mostrou que sites, principalmente de SaaS, que abusaram dessa tática perderam de 30% a 50% de visibilidade orgânica nas últimas semanas.

Quando você se coloca no ‘Top 1’ sem uma metodologia clara, sem testes reais de concorrentes e apenas para manipular a intenção comercial, você quebra a confiança. E o algoritmo, finalmente, está detectando esse viés.

Abaixo, um print do relatório da Lily Ray em que ela mostra a queda de visibilidade de um dos blogs analisados. Segundo ela, “para este site, a queda parece ter começado durante a Atualização Principal de dezembro e foi agravada por movimentações nas últimas semanas”:

O Impacto na IA (GEO – Generative Engine Optimization)

O que acontece na busca orgânica reflete na IA. Esses sites não caíram apenas nos links azuis; eles desapareceram dos AI Overviews e perderam relevância como fonte para o ChatGPT e Gemini.

Então, Lisane, devo parar de fazer listas? Não. Mas você precisa mudar o como.

A era do ‘truque’ de SEO acabou. Se for comparar, seja transparente. Tenha critérios. Ou melhor: invista em conteúdo focado no produto que mostre como você resolve o problema, sem precisar fingir que testou outras 10 ferramentas que você nunca abriu.

🔗 Fonte: Is Google Finally Cracking Down on Self-Promotional Listicles?

Migração Facilitada: Do ChatGPT para o Gemini

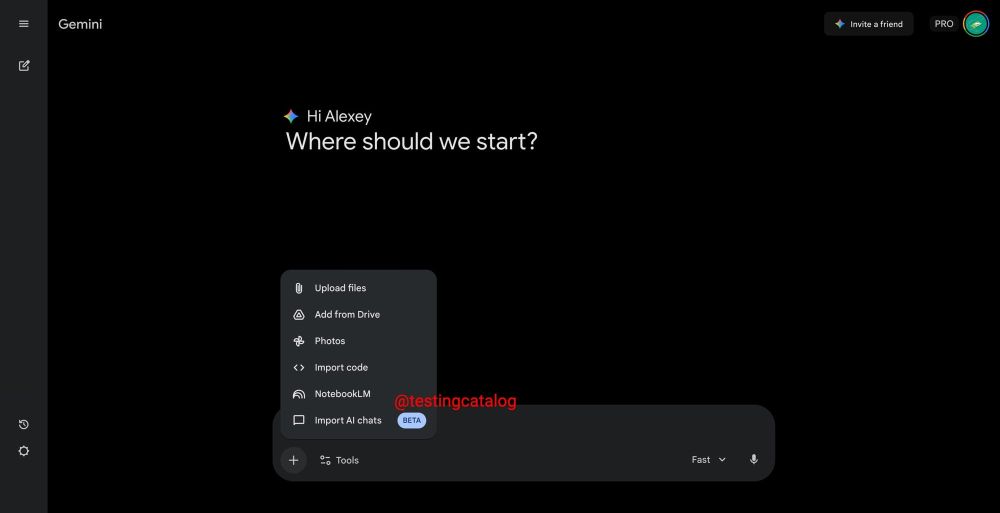

O Google está testando a funcionalidade “Import AI Chats”, permitindo que você suba seu histórico de conversas de outras IAs (como o ChatGPT) diretamente para o Gemini.

O Lado Estratégico: Isso elimina a barreira de entrada. Você não perde o contexto de meses de prompts refinados e aprendizados.

O Alerta de Privacidade: Segundo vazamentos, esses dados importados ficarão no seu histórico e serão usados para treinar os modelos do Google. Se você lida com dados proprietários ou sensíveis, a regra de ouro continua: atenção ao que você compartilha.

Veja abaixo onde encontrar este novo recurso no Gemini:

🔗 Fonte: Google will make it easier to import ChatGPT conversations to Gemini

Markdown para LLMs: Google e Bing não recomendam

Surgiu um debate na comunidade de SEO sobre criar páginas em Markdown (.md) paralelas ao HTML para facilitar a leitura por modelos de linguagem (LLMs). Google e Bing foram rápidos em “desrecomendar” a prática.

A justificativa é simples: robôs e IAs já são perfeitamente capazes de interpretar HTML semântico. Criar uma versão em Markdown pode ser interpretado como cloaking (mostrar um conteúdo para o robô e outro para o usuário), o que viola as diretrizes de qualidade.

Além disso, o Markdown carece de suporte para tags semânticas importantes que ajudam no contexto da página.

O foco deve ser um HTML bem estruturado e limpo; isso continua sendo o padrão ouro.

🔗 Fonte: Google & Bing don’t recommend separate markdown pages for LLMs

Rapidinhas do Mercado

- Bing com Busca em Múltiplas Etapas: A Microsoft lançou globalmente o “multi-turn search”. Conforme você rola a página, uma caixa do Copilot aparece na parte inferior, permitindo que as buscas subsequentes sejam baseadas na última consulta realizada. Leia mais.

- Novidade no Google Ads: A Rayanne Batista observou novos elementos nos anúncios da SERP, indicando testes de layout que podem impactar a taxa de clique. Veja o print.

O SEO em 2026 exige um equilíbrio entre eficiência técnica e autoridade de marca. Desde os novos limites do Googlebot até a inteligência do Bing, o objetivo final dos buscadores é entregar a melhor resposta com o menor ruído possível. Limpar o lixo do código e produzir conteúdo honesto não são mais apenas boas práticas; são requisitos de sobrevivência.

FAQ: Perguntas Frequentes

- O limite de 2 MB do Googlebot inclui imagens? Não diretamente, a menos que as imagens estejam codificadas em Base64 dentro do próprio HTML ou CSS. Imagens carregadas via URLs externas não contam para esse limite de leitura do arquivo de código.

- Minhas listas de “melhores produtos” vão parar de ranquear? Não necessariamente. Elas perderão força se forem puramente autopromocionais. Se você oferecer valor real, testes e comparações honestas, o conteúdo continua sendo relevante.

- Posso usar o Gemini para gerenciar dados de clientes sem riscos? É preciso cautela. Como o Google utiliza dados para treinamento, evite inserir informações sensíveis ou proprietárias na IA, a menos que esteja usando uma versão Enterprise com garantias explícitas de privacidade.

- Como verifico se minha página excede o limite de rastreamento? Você pode usar a ferramenta de inspeção de URL no Google Search Console ou simplesmente inspecionar a página no navegador (Aba Network) para ver o tamanho do recurso descompactado.

- O que é o Mapa de Autoridade da Niara? É nossa nova ferramenta que automatiza a criação de clusters de conteúdo, identificando gaps na sua estratégia para você se tornar autoridade tópica no Google.

Não há mais espaço para estratégias rasas, mas as oportunidades para quem faz um trabalho sério e técnico nunca foram tão grandes.

Quer simplificar essa jornada e focar no que importa? A Niara unifica análise de dados, criação de conteúdo e otimização técnica em um só lugar.

Experimente a Niara gratuitamente por 7 dias e escale seu SEO com inteligência.

Assista ao episódio completo do Otimização Semanal #24:

Gostou? Confira Otimização Semanal #25: WebMCP, Relatórios de IA no Bing e Vídeos como Fonte da Verdade para LLMs!