Googlebot e o Limite de 2MB: O que muda na indexação e como evitar o “corte” do seu conteúdo

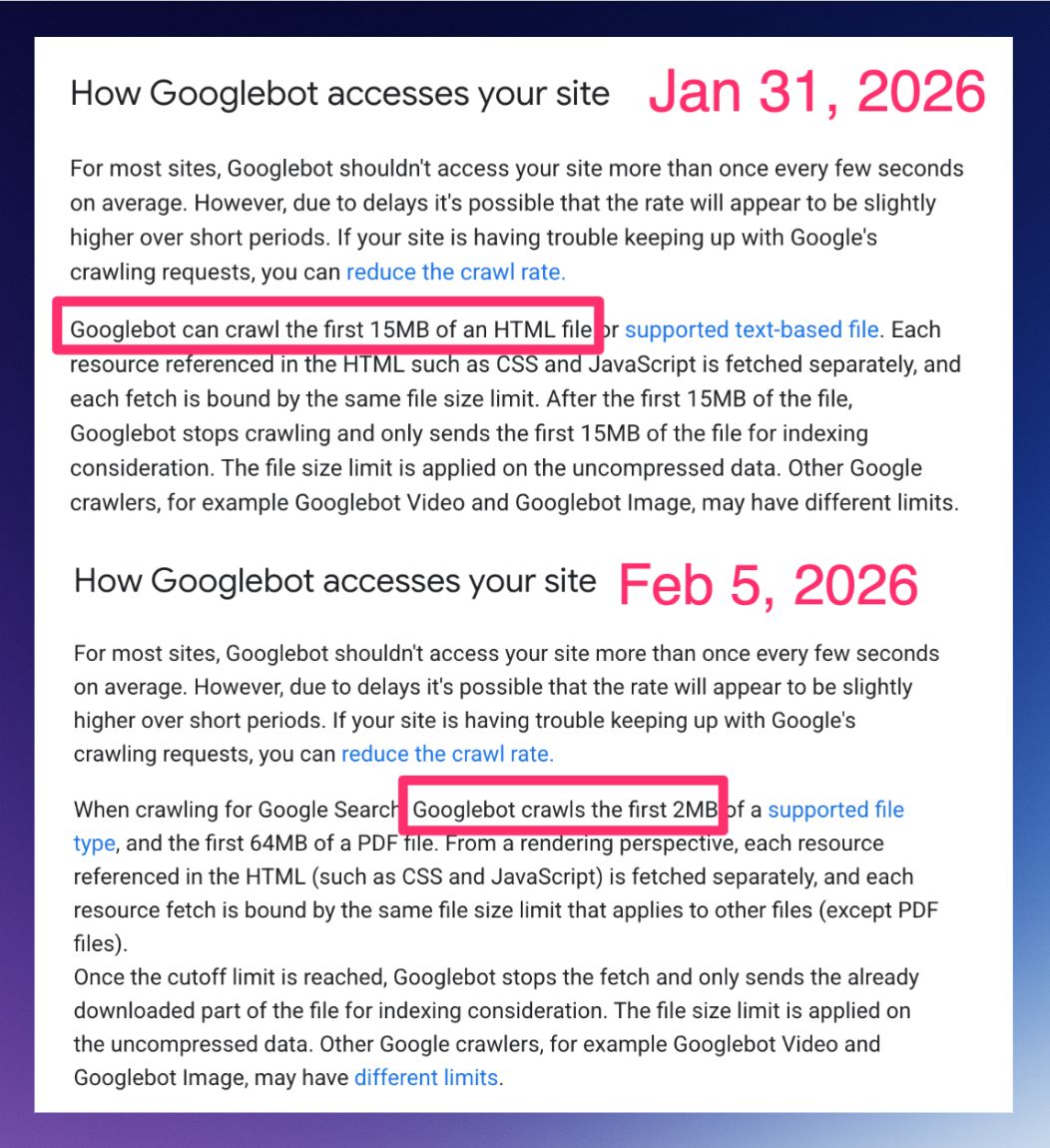

Recentemente, uma atualização na documentação oficial do Google gerou muitos comentários (e até dúvidas) na comunidade de SEO: o Googlebot agora declara explicitamente que rastreia (faz o download) apenas os primeiros 2MB de arquivos HTML e outros formatos suportados (com exceção de PDFs, que têm um limite maior).

Para muitos profissionais que estavam acostumados com números maiores, essa mudança acendeu um alerta vermelho. Será que o Google parou de ler o meu site? O conteúdo do rodapé está sendo ignorado?

Neste artigo, vamos desmistificar essa atualização, explicar tecnicamente o que conta para esse limite e, claro, como garantir que seu site continue performando bem.

O que diz a nova documentação do Google?

O texto oficial do Google é claro ao afirmar:

“When crawling for Google Search, Googlebot crawls the first 2MB of a supported file type… Once the cutoff limit is reached, Googlebot stops the fetch.”

Em português claro: o robô do Google baixa os primeiros 2MB do arquivo. Se o arquivo for maior que isso, ele corta o restante. O que foi baixado vai para a indexação; o que ficou de fora, é como se não existisse para o buscador.

Veja o print compartilhado pelo SEO Steve Toth destacando o que foi atualizado:

O Detalhe importante: dados não comprimidos

Aqui está a “pegadinha” técnica que muitos ignoram. O limite de 2MB se aplica aos dados não comprimidos (uncompressed data).

Mesmo que seu servidor envie o arquivo compactado (usando Gzip ou Brotli) e a transferência de rede seja de apenas 500KB, o Googlebot vai “descompactar” esse arquivo para lê-lo. Se, ao abrir o pacote, o arquivo original tiver 3MB, o Google vai ler os primeiros 2MB e ignorar o último 1MB.

Mitos e Verdades: respondendo às dúvidas do mercado

Vimos muitos comentários no LinkedIn e fóruns sobre o impacto real dessa mudança. Vamos simplificar o SEO e responder direto ao ponto às principais dúvidas:

1. O limite de 2MB é para a página inteira (HTML + Imagens + CSS)?

Não. O limite é aplicado por recurso (per resource). O seu arquivo HTML tem um limite de 2MB. A sua imagem de destaque tem o seu próprio limite. O seu arquivo CSS tem outro limite.

O Googlebot não soma tudo para ver se atingiu o limite. Ele avalia cada solicitação HTTP individualmente.

Isso é uma boa notícia para quem tem sites modulares, mas um pesadelo para quem centraliza tudo em arquivos gigantes.

Diferente dos demais, PDFs tem um limite bem superior, de 64MB.

2. Arquivos externos (JS e CSS) contam no limite do HTML?

Não. Como o Google busca cada recurso separadamente, um arquivo style.css externo não consome a cota de 2MB do seu documento HTML. Isso significa que modularizar seu código (usar arquivos externos em vez de colocar tudo inline no HTML) é uma excelente estratégia de segurança.

3. Sites em JavaScript (Client-Side Rendering) são mais prejudicados?

Sim, o risco é maior. Sites construídos como SPAs (Single Page Applications) que dependem de um arquivo JavaScript gigante (chamado bundle.js) para renderizar o conteúdo estão na zona de perigo.

Se o seu arquivo principal exceder 2MB (descompactado), o Google baixará uma versão truncada (cortada) do script e não conseguirá renderizar nada da página.

O ciclo do desastre: o script não executa > a página não renderiza > o Google vê uma tela em branco > adeus, indexação.

Quem está realmente em risco?

A maioria dos sites bem construídos não precisa se preocupar. Um arquivo HTML de 2MB é muito texto (pense em um livro inteiro). No entanto, alguns cenários técnicos pedem atenção imediata:

- Sites com “Code Bloat”: Páginas que inserem CSS e JS imensos diretamente no código fonte (inline) em vez de chamar arquivos externos. Por exemplo, temas de WordPress pesados ou construtores de página (como Elementor ou Divi) que, se mal configurados, injetam milhares de linhas de CSS e JS inline ou em arquivos únicos gigantescos.

- Imagens em Base64: Desenvolvedores que convertem imagens em código de texto e colam diretamente no HTML. Isso infla o tamanho do arquivo drasticamente. Eu já vi portais de notícia com códigos imensos e pesados, ao converter imagem em código de texto.

- Listagens Infinitas: E-commerces que carregam centenas de produtos no código inicial sem paginação ou lazy loading adequado.

- Mega Menus Excessivos: Códigos de menu que carregam milhares de links e estruturas ocultas no HTML.

2 Pontos cegos que podem derrubar seu SEO

Além do risco óbvio de a página não carregar, existem dois problemas silenciosos que ocorrem quando o Google corta o final do seu HTML:

1. O Fim do Link Juice (Links de Rodapé)

Se o Googlebot cortar os últimos bytes do seu HTML, ele não lerá o seu rodapé. É ali que geralmente ficam links importantes para páginas institucionais, políticas de privacidade e links cruzados.

Sem ler esses links, o Google não passa autoridade (Link Equity) para essas páginas, podendo torná-las órfãs.

2. Adeus, Rich Snippets (Dados Estruturados)

Muitos plugins e desenvolvedores inserem o bloco de Dados Estruturados (JSON-LD) no final do código <body> para não atrasar o carregamento visual. Se o HTML for cortado antes desse script, o Google não verá seus dados estruturados.

Resultado: você perde as estrelinhas, FAQs e snippets de produto na busca.

Dica: Utilize o gerador de daddos estruturados da Niara para gerar scripts em segundos!

Como se proteger e otimizar

Para garantir que o Googlebot consuma todo o seu conteúdo, siga estas boas práticas:

- Auditoria no DevTools: Verifique o tamanho da sua página diretamente via Chrome.

- Abra a página > Pressione F12 > Vá na aba Network.

- Recarregue a página (F5).

- Filtre por Doc.

- Olhe a coluna Size (o valor inferior/cinza é o descompactado). Se passar de 2MB, otimize.

- Tira-Teima no Google Search Console: Use a “Inspeção de URL” no Google Search Console. Clique em “Ver página testada” > “Código HTML”. Role até o final. Se a tag

</html>não estiver lá, o Google cortou sua página. - Conteúdo Importante no Topo: Garanta que títulos, metadados e o texto principal estejam no início do código HTML (

<head>e começo do<body>). Se houver um corte, que seja no rodapé, não em conteúdos importantes. - Evite Inline Excessivo: Mantenha seu HTML limpo. Jogue estilos e scripts para arquivos externos.

- Code Splitting para JS: Se você usa React, Vue ou Angular, divida seu código em pedaços menores (chunks) que são carregados apenas quando necessários, evitando um único arquivo monolítico gigante.

- JSON-LD no Topo: Mova seus scripts de Dados Estruturados para o

<head>. Veja outras recomendações para dados estruturados focados em IA.

O limite de 2MB não é o fim do mundo

O Google continua evoluindo para processar a web de forma rápida e sustentável. O limite de 2MB é apenas um lembrete técnico importante: eficiência de código também é SEO.

Na Niara, nós simplificamos o SEO para que você não precise se perder na complexidade técnica. E temos uma novidade incrível: a partir de março de 2026, você terá o Agente de SEO Técnico na Niara para te ajudar a auditar esses quesitos automaticamente.

Enquanto isso, use já nossa ferramenta para impulsionar sua estratégia, conteúdo e análise de dados e escalar seus resultados orgânicos.